Deutscher Ethik-Rat zur künstlichen Intelligenz

Ein Kommentar aus europäischer Perspektive

Der deutsche Ethikrat geht seinen eigenen Weg und zerlegt ganz nebenbei das von der EU beworbene Konzept einer vertrauenswürdigen KI.

Fast drei Jahre nach dem die Europäische Kommission die “Ethik-Leitlinien für eine vertrauenswürdige KI” (April 2019) einer sogenannten “hochrangigen Expertengruppe für künstliche Intelligenz” publiziert https://digital-strategy.ec.europa.eu/en/library/ethics-guidelines-trustworthy-ai und zu grossen Teilen für ihre eigene Arbeit übernommen hat, stellte nun der Deutsche Ethikrat am 20. März seine Stellungnahme zum Themenkomplex vor. Der Unterschied in den Ansätzen könnte nicht grösser sein und der Ethikrat ist sich dessen bewusst, wenn er festhält, dass er “auf einer anderen Ebene” https://www.ethikrat.org/pressekonferenzen/veroeffentlichung-der-stellungnahme-mensch-und-maschine/ an den “reichhaltigen Fundus an ethischen Leitlinien und (…) rechtlichen Regulierungsansätzen” anknüpft.

Mit der anderen Ebene ist die Einschätzung der philosophisch anthropologischen Ausgangslage gemeint. Anders als die Europäische Kommission und ihre Berater geht es dem Deutschen Ethikrat nicht um die Wettbewerbsfähigkeit der Union und die bewusste “Förderung einer vertrauenswürdigen KI”, sondern um ein tiefer liegendes Verständnis neuer technischer Möglichkeiten und deren vielfältigen Interaktionen mit dem Menschen und in der Gesellschaft.

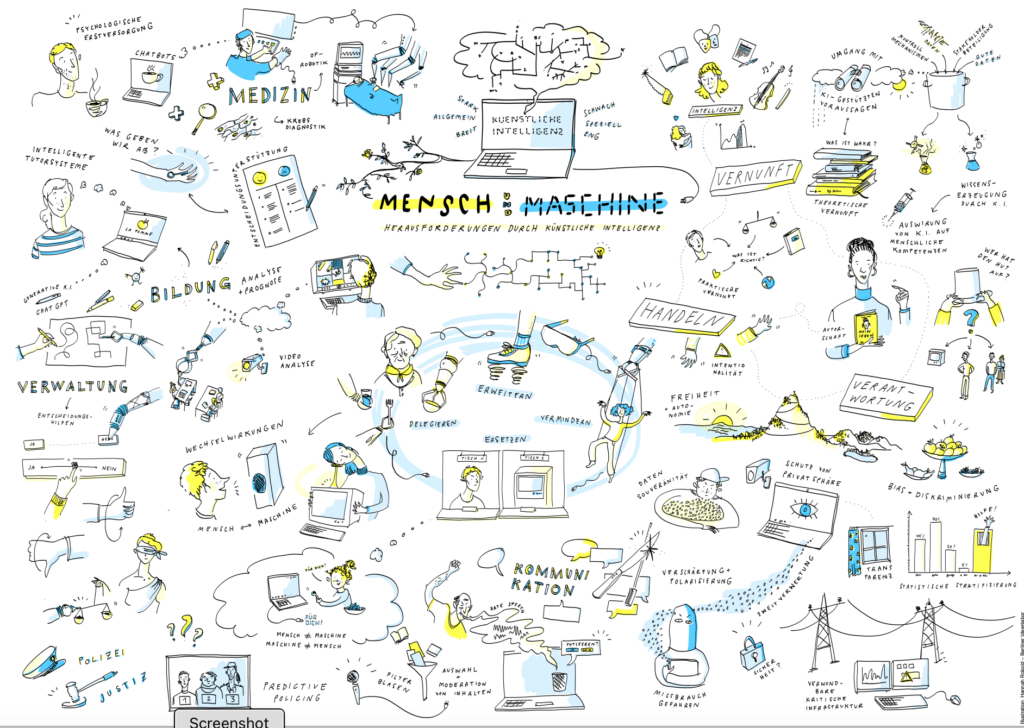

Entsprechend zurückhaltend ist der Deutsche Ethikrat, wenn es um eine globale Beurteilung der KI geht. Mit vielen Beispielen aus Medizin, Bildung, Medien und öffentlicher Verwaltung zeigt er exemplarisch und fachkundig, dass es auf die einzelnen Anwendungen und deren von Menschen bestimmten Zielrichtung ankommt. Deshalb sind denn auch nur differenzierte und von den Anwendungskontexten und -zielen abhängige Urteile hilfreich.

Das Wort “vertrauenswürdig” kommt in dem 280 Seiten starken Dokument fünfmal vor und verweist dabei neben der Publikation der hochrangigen Expertengruppe auf weitere Publikationen. Der Ethikrat entmythologisiert die neuen Techniken, indem er lapidar feststellt: “Die Anthropomorphisierung digitaler Technik ist in der Umgangssprache weit fortgeschritten” (S.125) Diesem “automation bias” unterliegt der Ethikrat nicht. Er wiederholt nicht einfach das anders, was schon viele andere Autoritäten in den öffentlichen Raum und Diskurs eingespeist haben, sondern bleibt seinem Anspruch einer anderen Ebene treu indem er “die Verwendung des Ausdrucks ‘Intelligenz’ in der Wortverbindung ‘Künstliche Intelligenz’ eher als Metapher” (S. 93) einordnet.

Auch wenn der Ethikrat sich kurz mit den Vorschlägen “geteilter Moralität” oder geteilter Verantwortung auseinandersetzt, hält er unmissverständlich fest, dass Moral und Verantwortung in der Philosophie neben dem Können, Vernunft und Freiheit voraussetzen. Ein enger Handlungsbegriff, “der an das zentrale Kriterium der Intentionalität gebunden ist”(s. 100), wird dem Menschen definitorisch vorbehalten. Damit fällt alles andere Tun unter den Begriff der Maschine. Auch wenn dieses technische Tun bisweilen menschliche Intelligenz, Handeln oder Verstehen simuliert, sollten kritische Menschen sich etwa durch anthropomorphe Sprache (vertrauenswürdige Maschinen lernen, verstehen, kommunizieren, …) nicht verführen lassen, diesem Absichten anzudichten.

Dem Ethikrat geht es im zweiten entscheidenden Gedankengang und anschliessend an seine “Bereinigung” der benutzten Datenmengen um das Verhältnis von Mensch und Maschine. Von seinem eingenommen moralischen Standpunkt aus beurteilt er in unterschiedlichen Bereichen und grundsätzlich die sogenannten “ADM-Systeme” (algoritmic / automated decision-making). Mit Bezug auf Artikel 22 der EU-Datenschutz-Grundverordnung soll kein Mensch zum Objekt einer allein auf Algorithmen basierenden Bewertung gemacht werden. ADM-Systeme können und sollten durchaus als “decision support systems” (S. 226) zur Anwendung kommen, weil sie nachgewiesenermassen in manchen Bereichen der sozialen Gerechtigkeit weniger anfällig für Verzerrungen und Vorurteile sind als etwa routinierte Sozialarbeiter oder Beamte.

Immer wieder warnt der Rat, dass Menschen, die mit KI-getriebenen Systemen arbeiten, die Oberhand behalten müssen. Deshalb müssen sie in der Ausbildung, Fort- und Weiterbildung sowie in den Unternehmen und Verwaltungen entsprechend unterstützt werden. Ziel muss immer die “Erweiterung menschlicher Autorschaft” (S. 248) sein und nicht etwa die blosse Effizienzsteigerung oder Einsparung von Personal.

Kritisch und innovativ zeigt sich der Ethikrat, wenn er — gegen den allgemeinen Trend in Europa — “neue Wege” im Umgang mit am Gemeinwohl orientierter Daten ins Gespräch bringt und Abstand von einer “vornehmlich individualistisch geprägten und damit verkürzten Perspektive” (S. 276) nimmt. Auch hier gilt es Risiken und Chancen von KI-Anwendungen undogmatisch und kritisch im Blick auf ihren Beitrag etwa zu einer besseren Gesundheitsversorgung abzuwägen.

Er bricht folgerichtig eine Lanze für die “Entwicklung geeigneter Verfahren und Institutionen” um KI-Anwendungen in Forschung und Gesellschaft “kontextspezifisch und demokratisch” (S. 283) zu beurteilen.

Der philosophisch gut fundierte Ansatz des Deutschen Ethikrat mag überkomplex gegenüber etwa den unterkomplexen Ethik-Leitlinien der EU wirken. Er schreibt sich ohne Wenn und Aber in die Tradition klassischer Philosophie ein und zeigt, dass es möglich ist, allgemein abgestützte Ethik auch in den vielfältigen Bereichen digitaler Techniken anzusiedeln und zu implementieren. Die lesenswerte Stellungnahme zeigt dies immer wieder anschaulich an konkreten Beispielen.

Ob sich die “andere Ebene” auf europäischer Ebene durchsetzen wird und sich eine genuine Ethik in den digitalen Techniken entfalten wird, ist offen. Es bleibt zu wünschen, dass diese neue und andere Ebene nicht nur in Deutschland rezipiert und kritisch besprochen wird, sondern weit darüber hinaus und vor allem innerhalb der Europäischen Union und ihren Gremien.

Erny Gillen, Luxemburg

21.3.2023