|

2024 - KI für das Militär braucht keine Sondermoral! Ein Zwischenruf zur Regulierung autonomer Waffensysteme, in: Ethik und Militär 1/2024, S. 24-27, 2024.06.17

2023 - Glaube im KI-Alter - im Podcast "Das glaub ich gern", ChatGPT, Midjourney, DALL-E und Snapchats MyAI sind aufregende Tools - Künstliche Intelligenz macht's möglich. Doch die Technologie kommt mit einigen ethischen und sozialen Fragen daher, und auch unser menschliches Selbstverständnis stellt die Generative KI infrage. Vielleicht auch unseren Gott!? Michael Brendel hat sich in Münster mit dem luxemburgischen Moraltheologen Prof. Dr. Erny Gillen zu einem Gespräch über KI und Glauben getroffen., Der spirituelle Podcast aus dem Ludwig Widhorst-Haus, Lingen (DE), 2023.10.04

- Interview : Konkordanz, statt Konkurrenz. Interview von Pierre Lorang zur Revitalisierung der Demokratie, Interview von Pierre Lorang über die Revitalisierung der Demokratie., forum für Politik, Gesellschaft und Kultur, Nr. 433 (September 2023), 2023.09.08

- LIVE Interview Pierre Lorang - Erny Gillen zur Revitalisierung der Demokratie, forum.lu, 2023.09.08

- "Auf einer anderen Ebene" - der deutsche Ethikrat zur KI, Der deutsche Ethikrat geht seinen eigenen Weg und zerlegt ganz nebenbei das von der EU beworbene Konzept einer vertrauenswürdigen KI.

Fast drei Jahre nach dem die Europäische Kommission die “Ethik-Leitlinien für eine vertrauenswürdige KI” (April 2019) einer sogenannten “hochrangigen Expertengruppe für künstliche Intelligenz” publiziert und zu grossen Teilen für ihre eigene Arbeit übernommen hat, stellte der Deutsche Ethikrat am 20. März 2023 seine Stellungnahme zum Themenkomplex vor.

Der Unterschied in den Ansätzen könnte nicht grösser sein und der Ethikrat ist sich dessen bewusst, wenn er festhält, dass er “auf einer anderen Ebene” an den “reichhaltigen Fundus an ethischen Leitlinien und (…) rechtlichen Regulierungsansätzen” anknüpft., Luxemburger Wort vom 27. Mai 2023 : Analyse & Meinungen p. 13, 2023.05.27

- Moral und Politik : Interview über das, was schiefläuft in der heutigen Politik, von Stefan Kunzmann, Das Gespräch mit dem Moraltheoretiker Erny Gillen führt von den Fragen des Gemeinwohls, die hinter den Fragen der individuellen Freiheiten zurückweichen, bis zu neuen Herausforderungen der Politik, etwa des Klimawandels und der Künstlichen Intelligenz., Tageblatt Nr. 120 : 25 Mai 2023, 2023.05.25

- Künstliche Intelligenz & Militär. Zu den LAWS, Dass die Verhandlungen zu den von künstlicher Intelligenz angetriebenen autonomen Systemen getrennt nach militärischen und zivilen Anwendungen geführt werden, hilft, die Ängste gegenüber ersteren in den Diskussionen um wirtschaftliche und soziale Anwendungen und deren potenziellen Vorteile auszuklammern. Dabei unterscheiden sich die Technik der künstlichen Intelligenz und die daraus resultierende sogenannte Autonomie in zivilen oder militärischen Anwendungen systemisch nicht. KI ist selbst ein typisches „dual-use“-Produkt., Luxemburger Wort 22. April 2023, 2023.04.22

2022 - Analyse des neuen Deontologiekodex : Fünf Kritikpunkte an Regierungsregeln, Interview-Artikel von Sidney Wiltgen, Tageblatt Nr.82 vom 7. April 2022, 2022.04.07

- Tech-Logy : Error.Codes.Future : A Defence of Academic Freedom, in: Erin Green, Divya Singh, Roland Chia (Eds.), AI Ethics and Higher Education. Good Practice and Guidance for Educators, Learners, and Institutions : ISBN: 978-2-88931-442-0 @Globalethics.net, 2022.03.10

2021 - Reliable, Righteous and Committed to the Service of Luxembourg and its Allies The Development of a Values Grid for the Luxembourg Army, The Luxembourg Army has agreed on its own Values Grid in a process initiated and expertly facilitated by the Ministry of Defense. It has therefore co-developed its own ethos, reflected on it, put it in writing and set it out in concrete terms in a Code of Conduct.1 This is a report on the prerequisites and challenges of such a participatory approach as well as on the essential findings (“lessons learned”). It was written in consultation with the Luxembourg Ministry of Defense., Steve Thull, Erny Gillen, ZEBIS E-JOURNAL, 2021.12.15

- Zuverlässig, rechtschaffen und engagiert im Dienste Luxemburgs und seiner Verbündeten Die Entwicklung eines Werte-Rasters bei der Luxemburger Armee, Die luxemburgische Armee hat sich in einem vom Verteidigungsministerium angestoßenen und fachlich moderierten Prozess auf ein eigenes Werte-Raster verständigt. So hat sie ihr eigenes Ethos mitentwickelt, reflektiert, schriftlich fixiert und in einem Verhaltenskodex1 konkretisiert. Dies ist ein Bericht über die Voraussetzungen und Herausforderungen eines solchen partizipativen Ansatzes sowie wesentliche Erkenntnisse („Lessons learned“). Er wurde in Abstimmung mit dem Luxemburger Verteidigungsministerium verfasst., Steve Thull, Erny Gillen, ZEBIS E-JOURNAL, 2021.12.15

- Den Dreh in die offene Zukunft wagen! Gerecht. Utopisch. Erzählerisch, Drei Thesen für Medizin und Ethik nach Corona (COVID19)., Hrsg.: Andreas FREWER, Kerstin FRANZÒ, Elisabeth LANGMANN, Die Zukunft von Medizin und Gesundheitswesen. Prognosen - Visionen - Utopien, Würzburg 2021, 275-285, Jahrbuch Ethik in der Klinik 2021, 2021.12.01

2020 - Welche Ethik führt weiter? Wie Moral zwischen den Gegensätzen die Richtung hält, Die Corona-Krise hat weltweit eine kollektive Situation geschaffen, in der viele Menschen zumindest zeitweise bereit waren, ihre Freiheitsliebe, ihre Vorstellungen von Selbstverwirklichung und ihre individuellen Bedürfnisse sozialethischen Erfordernissen unterzuordnen. Der Beitrag zeigt auf, welche Formen von Ethik helfen, vorhandene moralische Reservoirs mit ihren inneren Gegensätzen produktiv für die Zukunft zu nutzen, bevor biologische, klimatologische oder technische Sachzwänge die realen Freiheitsräume der Menschen mit ihren scharfen Grenzen immer mehr reduzieren oder gar schließen. Eine geschmeidige und flüssige Moral, die das Gute, das Richtige, das Gerechte und das Gesunde zum Ziel hat, kann vom Umgang der Medizin mit den Lebenskrisen lernen., 2020.12.01

- Do we still need Ethics [in times of Corona]. Morals holds the direction between opposite poles., The Corona crisis has created a collective situation worldwide for which many people were not prepared to subordinate their love for freedom, their ideas of self-realisation and their individual needs to social ethical requirements. This article shows which forms of ethics help to make productive use of existing moral reservoirs with their inner tensions for the future, before biological, climatological or technical constraints increasingly will reduce or even close down free choices. A supple and fluid morality, which aims at what is good, right, just and healthy, can learn from the way medicine deals with life crises., in: Martin Woesler, Hans-Martin Sass (Editors), Medecine and Ethics in Times of Corona, 99-106, 2020.11.20

2019 - Für eine ethisch vertretbare künstliche Intelligenz, 2019.08.19

- Stets zu Diensten. EU-Kommission korrigiert die 'Ethik-Leitlinien für eine vertrauenswürdige KI', die Experten in ihrem Auftrag ausgearbeitet haben, Seit dem 8. April liegen die überarbeiteten Ethik-Leitlinien für vertrauenswürdige künstliche Intelligenz (KI) nun offiziell vor. Ihnen vorausgegangen war ein Entwurf vom 18. Dezember (s. faz vom 10. Januar 2018, S.9), eine auf öffentlichen Druck um 14 Tage bis zum 1. Februar verlängerte Konsultation mit 511 Beiträgen sowie Zusammenkünfte mit Vertretern der Mitgliedstaaten. Erny Gillen analysiert und kommentiert die aktuelle Fassung der Leitlinien im Licht der Mitteilung COM (2019) 168 der Europäischen Kommission., 2019.04.24

- "Die Zeit ist mehr wert als der Raum" - Zeit rein!, Einladung zu einer spirituellen Unterbrechung, Spiritual Care 2019; 8(2):217-217, 2019.04.19

- Die Strategie der Konquistadoren, Ranga Yogeshwar, Erny Gillen, Zur Finanzierung ethischer Forschung an der Technischen Universität in München durch Facebook., 2019.01.29

- Die Zeit ist mehr wert als der Raum - Räume auf!, Gillen, Erny. 2019. „Die Zeit ist mehr wert als der Raum“ – Räume auf!. Spiritual Care. 8(1): 81-82., 2019.01.11

- DIE ETHIK - FALLE, Wie und wozu werden Fallen gebaut? Wer baut sie? Wer setzt sie aus? Diese und viele weitere Fragen stellen sich dem Leser des über die Feiertage, still und leise, zur öffentlichen Konsultation ins Netz gestellten Entwurfs von “Ethischen Richtlinien für vertrauenswürdige Künstliche Intelligenz (KI).

Der Entwurf ist Teil eines Verfahrens, das “Die Europäische Gruppe für Ethik der Naturwissenschaften und der neuen Technologien” im März 2018 mit angestossen hatte. Das unabhängige Gremium forderte die “Einleitung eines Prozesses (…), der den Weg für die Entwicklung eines gemeinsamen, international anerkannten ethischen und rechtlichen Rahmens für die Konstruktion, Produktion, Verwendung und Steuerung von künstlicher Intelligenz, Robotik und „autonomen“ Systemen bereiten würde.” Um hierfür einen Rahmen zu erstellen, hat die Europäische Kommission die High-Level Exert Group on Artificial Intelligence Mitte 2018 ins Leben gerufen. Bis März 2019 soll und will diese dann ihre ethischen Richtlinien liefern., Frankfurter Allgemeine Zeitung, vom 10. Januar 2019, Feuilleton, Seite 9, 2019.01.10

2018 - Ethical Collaboration between Humans and Autonomous and Intelligent Systems - for the benefit of Patients, AI/S can and should support humanity’s project of ethically powered freedom. This is is our unique door for an intended, but not necessary future. It is our exit from the pure law of nature and the entryway to build our history and culture through time. Under those preliminaries, the future of work remains open. Humans and machines will not be reduced to workforces but walk hand-in-hand toward an open, but better future.

On that pilgrimage, our four guiding principles promote a culture of dialogue and progress (cultura del encuentro) in order to peacefully build sublime communities, including so-called AI/S, as morally responsive systems.

Healthcare is a critical case study for a hand-in-hand cooperation between humans and machines for the benefit of patients. In healthcare, we have already learned in modern times that sometimes less is more., in: Rethinking Labour. Ethical Reflections on the Future of Work, ed. The Caritas in Veritate Foundation Working Papers 10, Geneva 2018, 2018.11.15

- My Friend the Algorithm: Theological-Ethical Challenge of Artificial Intelligence, Christoph Stückelberger / Pavan Duggal (editors) Cyber Ethics 4.0. Serving Humanity with Values, 93-100, ISBN 978-2-88931-264-1, 2018.11.07

- Sicurezza umana o sicurezza degli Stati, by Marco Dotti, in: Vita.it (9.7.2018), Short review of Concilium 2/18 including my contribution, 2018.07.09

- Genesis 3.0.-Unterwegs mit der künstlichen Intelligenz, Hirschberg 06/18, 354-356, 2018.06.06

- Pflegeausbildung im Zeitalter autonomer und intelligenter Systeme, Ethik und Leadership als Leitthemen einer zukunftsorientierten Ausbildung mit vier Schlüsselkompetenzen: besonnenes Übersetzen, kluge Vermittlung, gerechte Entwickler und mutige Anwälte., neue caritas, 9/2018, 18-20, 2018.05.16

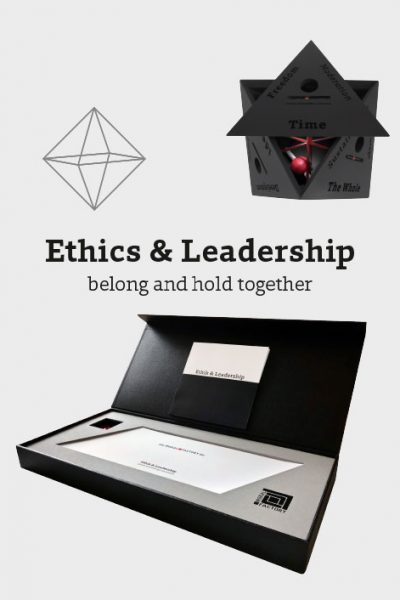

- Die Moral Factory für Ethik & Leitung, Flyer - deutsch, 2018.03.12

2017 - REZENSION VON PROF. DR. KLAUS BAUMANN, Amos International 11. Jg. (2017), s.50-51., 2017.11.30

- Mein Freund, der Algorithmus. Künstliche Intelligenz als theologisch-ethische Herausforderung, Viele Menschen fürchten sich vor einer Zukunft, die von maschinengemachter Intelligenz bestimmt wird. Sie übersehen, dass sie schon jetzt von ihr umgeben sind., Herder Korrespondenz 71(2017/10)49-51, 2017.10.05

- GENESIS 3.0., Eine Erzählung zur technischen Singularität, 2017.09.06

- DIE PAPST FRANZISKUS FORMEL BEIM CARITASVERBAND DER ERZDIÖZESE FREIBURG, DIE PAPST FRANZISKUS FORMEL BEIM CARITASVERBAND DER ERZDIÖZESE FREIBURG

Zur Tagung mit Werten wandeln vom 20. Juli 2017 in der katholischen Akademie in Freiburg, 2017.08.25

- Mit der Papst Franziskus-Formel in die offene Zukunft, Zum 150. Jubiläum des St.-Marien-Stift Friesoythe, 2017.08.11

- Spiritual Care, Trägerschaft und Management von Krankenhäusern, Interview

Echard Frick, Klaus Baumann, Erny Gillen, Jörg Lindenmaeier, Lydia Maidl und Diter Tscheulin

Zum Thema: Spiritual Care, Trägerschaft und Management von Krankenhäusern., Spiritual Care 6 (2017) 341-347., 2017.07.12

- Rezension von Anne Chevalier, Rezension im Luxemburger Wort vom 1. Juli 2017, S. 25, Luxemburger Wort, 2017.07.01

- REZENSION VON EKHARD FRICK SJ, "Andererseits lässt sich Gillens Methode zwanglos auf Leadership in anderen Bereichen von Kirche und Gesellschaft anwenden" (Eckard Frick, SJ), Stimmen der Zeit 6/2017 S.427-428., 2017.05.29

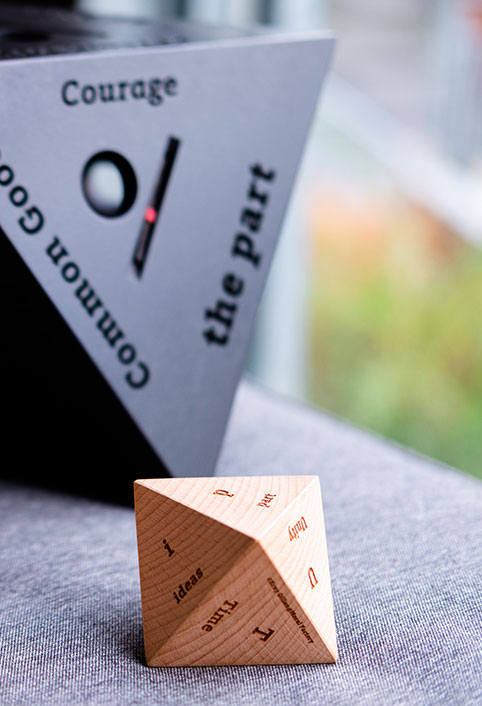

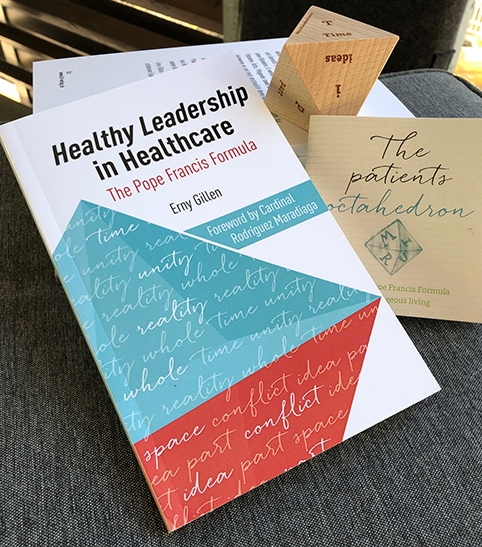

- gesund geführt im Krankenhaus. Die Papst Franziskus Formel. Zweite erweiterte Auflage mit einem Vorwort von Kardinal Rodriguez Maradiaga, Aus den vier grundlegenden Prinzipien von Papst Franziskus entwickelt Erny Gillen dessen Leadership-Formel systematisch und übersetzt sie in die handliche Form eines Oktaeders. Er wendet die Formel für Patienten, Ärzte, Pflegende sowie das Management im Gesundheitswesen an und zeigt anschaulich deren konkreten Nutzen für den Alltag.

Mit der Papst-Franziskus-Formel bringt er Ethik und Leadership in einen ansprechenden und vielseitigen Dialog, der direkt in die Praxis führt und Menschen dazu bewegt, die Spannungsenergien aus ihren Arbeits- und Beziehungswelten kreativ für den gemeinsamen Weg zu nutzen., ISBN 978-3-643-90875-9, 2017.04.03

- Leadership in eine offene Zukunft! Die Papst-Franziskus-Formel, Ethisches Leadership in die offene Zukunft, setzt Vertrauen und Methode voraus. Papst Franziskus nutzt eine eigene Methode, die er explizit in Evangelii gaudium offenlegt. In diesem Beitrag wird gezeigt, wie seine Methode Leadership und Ethik organisch verbindet. Erny Gillen stellt dar, wie die Methode systematisch in den päpstlichen Schreiben Laudato si’ sowie Amoris laetitia und den sie hervorbringenden Kontexten klug eingesetzt wird, um Bewegung in festgefahrene Situationen zu bringen. Die Papst Franziskus Leadership Formel legt den Weg von der moralischen Überzeugung hin zum aktiven moralischen Handeln.

Keywords: Papst Franziskus, Ethik und Leadership, “Evangelii gaudium”, “Laudato si’”, “Amoris laetitia"., Studia Teologiczno | Slaska Opolskiergo 36(2016), nr 2, p. 10-30., 2017.03.24

- PAPST FRANZISKUS SEIT 4 JAHREN IM AMT (LUXEMBURGER WORT / ONLINE), 2017.03.13

- VIER JAHRE PAPST FRANZISKUS (INTERVIEW MIT CHRISTIANE FLORIN (DLF)), 2017.03.13

2016 - Maximpact-Blog EG : Healthy Leadership, Looking for new and innovative methods in the Leadership arena, brought me — as many others — to Pope Francis. He is perceived as a special Leader being the CEO of the biggest organised religion, the first international church structure and the most prominent opinion leader in social moral affairs.

Pope Francis first convinced because of his personality. He bowed to the faithful first and only after receiving their blessings and prayers he provided his blessing. Many observers and commentators describe at length both his humbleness and his resolve, but they overlook his method.

But why is it so hard to see the method a contemporary leader uses on a daily basis? That is without any doubt because you normally do not see any methods in action. We are trained to look at people, at their input and their output. But what happens in people we do not see? What happens in leaders often remains a secret., 2016.12.12

- Healthy Leadership in Healthcare. The Pope Francis Formula, Just as an unhealthy lifestyle can lead to disease, so too can a poorly managed hospital lead to unhealthy outcomes. Leading a life and leading a hospital both have practical consequences and carry moral weight. Healthy Leadership gets to the heart of ethical leadership in healthcare management and describes a style of leadership that fosters healthy outcomes for hospitals, physicians, nurses, and patients.

Distinguished ethicist, Dr. Erny Gillen, draws upon his extensive practical experience in healthcare systems, as well as his years of research and teaching, to develop a multi-faceted yet compact leadership formula.

Based upon Pope Francis’ surprisingly open and successful leadership style and his writings, Dr. Gillen outlines an approach that encourages movement and healthy change throughout the field of healthcare. This insightful adaptation and application of Francis’ management style to leadership in healthcare is a notable contribution that deserves serious consideration., Charleston, SC, USA, 2016.12.04

- REZENSION VON "gesund geführt im Krankenhaus", Alex FRITZ, neue caritas, 117. Jahrgang, Heft 16 (26.09.2016), S.49., Rezension mit 5 Sternen, 2016.09.28

- Zwei Päpste, eine Kirche und letzte Gespräche, Der ehemalige Papst Benedikt führt „letzte Gespräche“, die polarisieren. Erny Gillen spürt der Bewegung der Äußerungen nach und trifft auf ein Prinzip Leadership à la Franziskus…, ISSN 2518-3982, 2016.09.14

- Es ist keine Zauberformel. Erny Gillen zur Franziskus-Formel und wie sie die Welt verbessern kann, Interview von Dani Schumacher, im: Luxemburger Wort vom 20./21. August 2016, S 1 und 2., 2016.08.20

- Eine Rezension von Prof. Dr. med. Eckhard Frick SJ, ... einfach würfeln und doch intensiv nachspüren über das Krankenhaus - über Menschen und Organisation, 2016.08.08

- Gesund geführt im Krankenhaus. Die Papst Franziskus Formel, 2016.08.04

- Für eine neue Theologie der Moral und eine integrale Welt-Ethik. Wie Papst Franziskus Theologie und Ethik von innen heraus neu ausrichtet, in: Horizonte gegenwärtiger Ethik, FS für Josef Schuster sj, Freiburg 2016, 268-279., 2016.07.15

- Der humanitäre Imperativ und seine Folgen, in Pfarrbrief des Pfarreienverbund Ebrachgrund, 2016.07.01

- Neue Verhältnisse in Luxemburg zwischen Staat und Religionsgemeinschaften, in: österreichisches Archiv für Recht & Religion, ISSN 1560-8670, 2016 (61. Jahrgang 2014 - 2), S. 244 - 269., 2016.06.24

- Der humanitäre Imperativ und seine Folgen, in: feinschwarz, Wer spontan hilft, braucht irgendwann den langen Atem guter Organisation. Erny Gillen liest die Erzählung vom barmherzigen Samariter als Aufruf zur Nachhaltigkeit in Sachen Solidarität., 2016.03.02

- Lettre du CEERE – Mars 2016, Numéro 94, Université de Strasbourg, Strasbourg, 2016.03.01

- Wir sitzen alle im gleichen Boot. Nachdenkliches zu Glaube und Moral, 2016.02.18

2015 - Darüber müssen jetzt andere entscheiden, Interview in: forum für Politik, Gesellschaft und Kultur, Nr 355 Oktober 2015, 2015.10.01

- Audience with the Prime Minister of Luxembourg: assistance to refugees and displaced persons, News.va, Vatican, 2015.09.18

- Luxembourg PM gives book to pope, Wort.lu, Luxemburg, 2015.09.17

- Premier Bettel beim Papst, Wort.lu, Luxembourg, 2015.09.17

- Une visite européenne au Saint-Siège en pleine crise migratoire, La-Croix.com, Rome, 2015.09.17

- Xavier Bettel rencontre le pape François, Wort.lu, Luxemburg, 2015.09.17

- Weniger Geld, kein Religionsunterricht - kann das eine Chance für die Kirche sein?, SWR, 2015.07.23

- Lehren aus Luxemburg, Wort.lu, Luxemburg, 2015.07.21

- Neue Verhältnisse in Luxemburg – zwischen Staat und Religionsgemeinschaften, Cathol.lu, 2015.07.21

- Support for Pope Francis, The International Parish of Luxembourg, 2015.05.07

- Support for Pope Francis from Luxembourg, Luxemburg Wort, 2015.05.06

- Comment un pape peut guérir les maladies de la curie. Lettre ouverte, Verlag éditions Saint Paul, Luxemburg 2015, 2015.05.05

- De cómo un Papa puede curar las enfermedades de la curia. Una carta abierta, Verlag éditions Saint Paul, Luxemburg 2015, 2015.05.05

- How a pope might treat curial diseases. An open letter, Verlag éditions Saint Paul, Luxemburg 2015, 2015.05.05

- Erny Gillen, Publik-Forum Nr. 8 / 2015, 2015.05.01

- Invité vum Dag, Radio 100,7, 2015.04.27

- Das Ende des Vatikan-Staats, Wort.lu, 2015.04.23

- De fréiere Generalvikar huet en neit Buch eraus bruecht, RTL.lu, 2015.04.23

- Mit spitzer Ferder gegen dicke römische Mauern, Luxemburg Wort, 2015.04.23

- Luxemburgischer Theologe plädiert für Entmachtung der Kurie, Kath.ch, 2015.04.02

- Neuerscheinung: Wie ein Papst Kurien-Krankheiten heilen kann, Cathol.lu, 2015.04.02

- Wie ein Papst Kurien-Krankheiten heilen kann, Ein offener Brief, Editions Saint Paul, Luxemburg, 2015.04.02

- Zum Friedens- und Heilungspotential des Neuen Vertrags, Zu den Verträgen des Luxemburger Staates mit den religiösen Gemeinschaften aus katholischer Sicht., 2015.01.31

2011 - Opmierksam a konkret - politesch sinn, Luxemburger Wort, Die Warte, 2011.10.21

- Endlichkeit Glück und Unglück des Menschen (PPT), Saarbrücken, 2011.09.09

- Zur Euthanasie in Luxemburg (PPT), Quarten, 2011.09.04

- Die offene Frage nach dem Nächsten, Te Deum Juli 2011, 2011.07.01

- Sterben wieder in die Mitte holen, Tiroler Tageszeitung, 2011.05.29

- Homélie tenue pour l'Assemblée Générale de Caritas Internationalis (Text), Rome, 2011.05.27

- Den Wandel gestalten - zwischen „pflege.com“ und „pflege.org“ in der „pflege.eu“ (PPT), Kassel, 2011.05.17

- Den Wandel gestalten - zwischen „pflege.com“ und „pflege.org“ in der „pflege.eu“ (Text), Kassel, 2011.05.17

- Caritas Europa für eine Steuer gegen Armut, Tiroler Tageszeitung, 2011.05.05

- Caritas ein zukunftstiftender Gesellschaftsentwurf in Bewegung(en) (PPT), Innsbruck, 2011.05.03

- Caritas ein zukunftstiftender Gesellschaftsentwurf in Bewegung(en) (Text), Innsbruck, 2011.05.03

- Interview Tiroler, ORF, 2011.05.03

- Stratégies d'action des Caritas en Europe et dans le monde (PPT), Lourdes, 2011.03.23

- Stratégies d'action des Caritas en Europe et dans le monde (Text), Lourdes, 2011.03.23

- Deus Caritas Est en action (PPT), Praia, 2011.02.22

- Formation sur la doctrine sociale de l'Eglise (PPT), Praia, 2011.02.22

- Lire dans l'encyclique Caritas in Veritate (PPT), Praia, 2011.02.22

- Crossroads Forum Caritas Europa (PPT), Bruxelles, 2011.02.10

- Menschen und ihre Rechte: Zum Recht auf Leben, Luxemburger Wort, 2011.01.08

- Die offene Frage nach dem Nächsten oder Vom schweigenden Samariter, Benediktinerabtei Maria Laach, Verlag Katholisches Bibelwerk (Hg): Te Deum. Das Stundengebet im Alltag; Ars liturgica Buch- und Kunstverlag und Verlag Katholisches Bibelwerk, Maria Laach und Stuttgart, 2011

- Le signe de Dieu fait homme: un monde de caritas sans frontières, Cardinal Rodriguez Maradiaga S.D.B., Oscar Andres : Amour reçu et donné, Une réflexion théologique ; Editions Saint Paul, ISBN 978-2-87963-814-0, Luxemburg, 2011

- Sozial wirtschaften – nachhaltig handeln, Organisation des Sozialen in Europa - Orientierungswissen für Führungskräfte, in: König, Joachim, Oerthel, Christian und Puch, Hans-Joachim (Hg): Consozial 2010, Sozial wirtschaften – nachhaltig handeln, ISBN 978-3-86906-146-7, Allitera Verlag, München, 2011

2010 - Formation sur la doctrine sociale de l'Eglise (PPT), Luxembourg, 2010.12.07

- Die Politik wird orientierungslos, Télécran Nr 49/2010, 2010.12.01

- Opmierksam a konkret – politesch sinn, Journée du Personnel de Caritas Accueil et Solidarité asbl (PPT), Luxembourg, 2010.11.12

- Opmierksam a konkret – politesch sinn, Journée du Personnel de Caritas Accueil et Solidarité asbl (Text), Luxembourg, 2010.11.12

- Vers une meilleure prise en compte de la qualité de vie, Table ronde PIB (PPT), Luxembourg, 2010.11.11

- Vers une meilleure prise en compte de la qualité de vie, Table ronde PIB (Text), Luxembourg, 2010.11.11

- Messe de la Charité - Homélie par Père Erny Gillen (Text), Forbach, 2010.11.07

- Organisation des Sozialen in Europa - Orientierungswissen für Führungskräfte, Consozial 2010 (PPT), Nürnberg, 2010.11.03

- Organisation des Sozialen in Europa - Orientierungswissen für Führungskräfte, Consozial 2010 (Text), Nürnberg, 2010.11.03

- Schwangerschaftsabbruch - eine gesellschaftspolitische Frage, Luxemburger Wort, 2010.10.30

- Wohin? Wenn nicht zurück? (PPT), Fulda, 2010.10.20

- Opmierksam a konkret - politesch sinn (PPT), Luxembourg, 2010.10.16

- Opmierksam a konkret - politesch sinn (Text), Luxembourg, 2010.10.16

- Le continent européen a besoin de ses migrants, Le Journal de Saône-et-Loire, 2010.10.03

- Euthanasie im Angebot. Zur politisch-rechtlichen Neu-Organisation moralischer Normen in Luxmburg, in Ethik organisieren, Handbuch der Organisationsethik, 2010.10.01

- Official handover between the outgoing and the incoming Secretary general of Caritas Europa (PPT), Bruxelles, 2010.09.28

- Official handover between the outgoing and the incoming Secretary general of Caritas Europa (Text), Bruxelles, 2010.09.28

- Drei Fragen an Erny Gillen, Luxemburger Wort, 2010.09.25

- En marche artisans de paix, Journée de l'Aumonerie (PPT), Luxembourg, 2010.09.13

- Fighting against poverty in Europe (PPT), Milano, 2010.09.11

- Building a caring society, Home Care Forum Caritas Europa (Text), Vilnius, 2010.09.06

- Caritas in Europe and Caritas in the Nordic Countries (PPT), Bergen, 2010.09.03

- Pour un développement intégral, Formation des Sœurs de la Doctrine Chrétienne (PPT), Diekirch, 2010.07.30

- Schutz der Ehe zwischen Mann und Frau, Revue, 2010.07.15

- Zur Euthanasie in Luxemburg (PPT), Zürich, 2010.07.02

- Ethique planetaire defis pour la pluralité des relitions et convictions (PPT), Luxembourg, 2010.06.30

- The Multidimensionality of Poverty (PPT), Poznan, 2010.06.18

- Das katholische Krankenhaus eine Glaubensfrage (PPT), Erfurt, 2010.06.16

- Das katholische Krankenhaus eine Glaubensfrage (Text), Erfurt, 2010.06.16

- Erny Gillen reconduit au poste de president pour 4 ans, La Voix, 2010.06.05

- Gillen bleibt Präsident von CE, Luxemburger Wort, 2010.06.04

- Erny Gillen re-elected President, Caritas Europa, 2010.06.03

- Conférence Régionale Caritas Europa 2010 - Discours d'ouverture (Text), El Escoria, 2010.06.01

- The Mood Changes, Luxembourg for Finance, 2010.06.01

- Combattre la pauvreté en Europe et dans le monde – Recommandations à l’Union Européenne (Text), Paris, 2010.05.27

- Intervention d’Erny Gillen, Président de Caritas Europa, au colloque sur les politiques européennes de lutte contre la pauvreté (Text), Paris, 2010.05.27

- Gesellschaftliche Auffassungen zur Migration, VIII europäischer CCEE Kongress, (Text), Malaga, 2010.04.27

- New calls for ethics and integrity, LIGFI, (PPT), Luxembourg, 2010.04.27

- Caritas: une présence de l’Eglise dans un monde qui a besoin de charité et de justice (PPT), Bruxelles, 2010.04.15

- Interview La povertà è un'offesa alla dignità umana, www.terzosettore.lavoro.gov.it, 2010.04.01

- Patienten verfügen über sich und ihr Leben (PPT), Rumelange, 2010.03.26

- Armut bekämpfen - von Novosibirsk bis Lissabon!, Caritas Schweiz Wir Helfen Menschen Nr 1/März 2010, 2010.03.25

- Mit Sport etwas Gutes tun (Postlaf 2010), Luxemburger Wort, 2010.03.15

- Armut in Europa – Ursachen, Ausprägung, Lösungsstrategien (PPT), Zürich, 2010.03.10

- Armut in Europa – Ursachen, Ausprägung, Lösungsstrategien (Text), Zürich, 2010.03.10

- Patienten verfügen über sich und ihr Leben (PPT), Steinsel, 2010.03.08

- Deus caritas est en action (PPT), Kinshasa, 2010.02.15

- Lire dans l’encyclique Caritas in veritate (PPT), Kinshasa, 2010.02.15

- Des gestes forts et symboliques contre la pauvreté (Article), Radio Vatican, 2010.02.12

- Des gestes forts et symboliques contre la pauvreté (Interview à écouter), Radio Vatican, 2010.02.12

- Deal mit Steuerdaten - Rechtsstaatlichkeit außer Kraft gesetzt, Télécran 7/2010, 2010.02.11

- Armut ist schlicht inakzeptabel, Luxemburger Wort, 2010.01.28

- Launch event on Zero Poverty, the CE campaign for the European Year for Combating Poverty and Social Exclusion (Text), Bruxelles, 2010.01.27

- Euthanasie im Angebot. Zur politisch-rechtlichen Neu-Organisation moralischer Normen in Luxmburg, Krobath, Thomas und Heller, Andreas (Hg.): Ethik organisieren. Handbuch der Organisationsethik, ISBN 9783784119809, Lambertus-Verlag, Freiburg i.Br., 2010

- Slowo wstepne, Kalinowski, Miroslaw und Niewiadomska, Iwona (Hg): Skazani na wykluczenie!? Zasoby adaptacyjne osob zagrozonych marginalizacja spoleczna, ISBN 978-83-7702-113-2, Wydawnictwo KUL, Lublin, 2010

2009 - Das Klima schützen die Schöpfung bewahren, Luxemburger Wort, 2009.12.15

- Renew the face of Earth: Faith-based approaches to climate justice (PPT), Copenhagen, 2009.12.14

- Renew the face of Earth: Faith-based approaches to climate justice (Text), Copenhagen, 2009.12.14

- Unischtbar, Caritas Concret Nr 3, 2009.12.01

- Caritas in Veritate a change agent for Caritas? (PPT), Bucharest, 2009.11.28

- Reading through the encyclical Caritas in veritate - CE 4th Management Forum Paris (PPT), Paris, 2009.11.17

- Reading through the encyclical Caritas in veritate - CE 4th Management Forum Paris (Text), Paris, 2009.11.17

- Das Leben ist ein Geschenk - Suizid, Luxemburger Wort, 2009.11.14

- Mit Wörtern um Worte ringen, Patientenverfügungen - ein Zeichen und Ausdruck unserer Zeit (PPT), Trier, 2009.11.12

- Lebensverlängerung oder Lebensverkürzung - Kriterien einer ethischen Entscheidungsfindung (PPT), Köln, 2009.11.10

- Mauern schützen und trennen - Twenty year since the fall of the wall in Berlin (PPT), Berlin, 2009.11.07

- Das Ende des Lebens in den Händen des Gesetzes, zur Situation in Luxemburg, Zeitschrift für medizinische Ethik 11.2009, 2009.11.01

- Moral Theologian and Bioethicist from Luxembourg 25.8.09 Euthanasie, Nathanial Report 11.2009, 2009.11.01

- Zur Euthanasie in Luxemburg - Pastorale Fortbildung (PPT), Luxemburg, 2009.10.13

- Deus caritas est in Aktion, Warschau Symposium - Nic nie zastapi milosci, 2009.10.04

- Caritas in veritate Sozial aktiv ginn… mam Sozialwuert (PPT), Luxemburg, 2009.10.03

- Wieviel Ethik verträgt ein Krankenhaus? Ethische Identität und Christlicher Glaube als Wurzeln verantwortungsvollen Handelns in christlichen Krankenhäusern (PPT), Ludwigshafen, 2009.09.29

- Let my people go - Caritas Europa Migration Forum (Text), Warsaw, 2009.09.17

- Caritas in veritate - Erklärungen für Mitarbeiter der Caritas Luxemburg (PPT), Luxemburg, 2009.09.14

- Weltethos - eine ethische Antwort auf die Herausforderungen unserer Zeit (PPT), Luxemburg, 2009.09.04

- Wirtschaft braucht Ethik, Telecran 37/2009, 2009.09.04

- Let my people go - Caritas Europa Migration Forum (PPT), Warsaw, 2009.09.01

- Caritas: variety within unity - at organizational and theological level - in Europe (PPT), Leuven, 2009.07.13

- Lettre ouverte aux Hommes, La Voix, 2009.07.08

- Von der Unentgeltlichkeit, Bischofsvikar Erny Gillen über die Sozialenzyklika von Papst Benedikt XVI, Luxemburger Wort, 2009.07.08

- Caritas in veritate - Für eine Kultur der Liebe!, Erklärungen zu Caritas in veritate, 2009.06.29

- Einladung zu einem Sozialwort der katholischen Kirche in Luxemburg - Referat zum « Sozialwort » (PPT), Luxemburg, 2009.06.13

- Erny Gillen commentaire élections 2009, La Voix Nr 131, 2009.06.08

- Caritas Europa Welcomes the New European Parliament, Flyer Caritas Europa, 2009.06.01

- Vor Gott und für die Menschen leben. Zum fünften Gebot, Magnificat, 2009.06.01

- Wie Ethik und Soziale Arbeit zusammengehören, Uni-Handbuch 06.2009, 2009.06.01

- Best praxis from Europe - Activities in year 2010 in Europe (PPT), Sarajevo, 2009.05.20

- Best praxis from Europe - Activities in year 2010 in Europe (Text), Sarajevo, 2009.05.20

- Conférence régionale caritas Europa (Texte), Bruxelles, 2009.05.15

- Caritas – Sakrament der Einheit für das Leben der Welt? - Theologisch und pastoral nachgefragt, Una Sancta, 2009.05.01

- Interview mam Erny Gillen zum Engagement vun der Caritas am Themeberäich vum Klimaschutz, de Kéisécker Nr 02/2009, 2009.05.01

- Some conclusions for Caritas in the turmoil of the crisis, Caritas Europa Social Policy Forum (Text), Social Policy Forum Prague, 2009.04.29

- The five-minute interview, Social Platform, 2009.03.01

- Caritas: Diversité dans l'unité - d'un point de vue organisationnelle et théologique - en Europe (PPT), Rome, 2009.02.10

- 63ª Asamblea General Caritas Espagnola (PPT), El Escorial, 2009.01.31

- Würde des Menschen – Dialyse am Ende des Lebens (PPT), Dialyse am Ende des Lebens - 19. Göppinger Tagung über Nieren- und Hochdruckkrankheiten, Bad Boll, 2009.01.23

- Caritas: Vielfalt in der Einheit - organisatorisch und theologisch - in Europa (PPT), Freiburg, 2009.01.22

- Wieviel Ethik verträgt ein Krankenhaus? Patientenbetreuung aus ethischer Verpflichtung. Ethische Identität und christlicher Glaube als Wurzeln verantwortungsvollen Handelns in der Begegnung mit Patienten (PPT), Ludwigshafen, 2009.01.21

- Caritas – Sakrament der Einheit für das Leben der Welt? Theologisch und pastoral nachgefragt, Ehret, Jean und Möde, Erwin (Hg): Una sancta catholica et apostolica, Einheit und Anspruch des Katholischen; Herder Verlag, Freiburg i.Br., 2009

- Das Ende des Lebens in den Händen des Gesetzes, Zur Situation in Luxemburg, in: Schockenhoff, Eberhard (Hg): Zeitschrift für medizinische Ethik, Ostfildern, 2009

- Deus Caritas est in Aktion (Deus Caritas est w dzialaniu), Fundacja « Pro Caritate » (Hg) : Nic nie zastapi milosci, Warschau, 2009

- Soziale Dienstleistungen. Ein Fall für die europäische Wettbewerbsordnung?, zusammen mit Robert Urbé und Anke Thiel, Amosinternational. Gesellschaft gerecht gestalten. 3.Jg., Heft 1, Dortmund, 2009

- Vor Gott und für die Menschen leben. Zum fünften Gebot, Benediktinerabtei Maria Laach und Verlag Katholisches Bibelwerk (Hg):Te Deum. Das Stundengebet im Alltag, Ars Liturgica Buch- und Kunstverlag und Verlag Katholisches Bibelwerk, Maria Laach und Stuttgart, 2009

- Vorwort, Schronen, Danielle und Urbé, Robert (Hg); Sozialalmanach 2009. Schwerpunkt: Nachhaltigkeit der sozialen Sicherung. L’annuaire Caritas sur la situation sociale du Luxembourg, Luxemburg, 2009

- Wettbewerb für soziale Dienstliestungen - Amosinternational Internationale Zeitschrift für christliche Sozialethik, Schwerpunktthema soziale Dienstleistungen, 2009

- Wie Ethik und Soziale Arbeit zusammengehören, Willems, H./Rotink, G./ Ferring, D./ Schoos, J./ Maejrus, M./ Ewen, N./ Rodesch-Hengesch, M.A./ Schmit, C. (Hg): Handbuch der sozialen und erzieherischen Arbeit in Luxemburg / Manuel de l’intervention sociale et éducative au Grand-Duché de Luxembourg, éditions saint-paul, Luxemburg, 2009

2008 - Kompetenz und Geist – Führen und leiten in kirchlichen Einrichtungen – Ethik als Entwicklung (PPT), Waldbreitbach, 2008.12.12

- Kompetenz und Geist – Führen und leiten in kirchlichen Einrichtungen – Fördern und fordern sogenannte ethische Gremien ethische Kompetenz (PPT), Waldbreitbach, 2008.12.12

- Kompetenz und Geist – Führen und leiten in kirchlichen Einrichtungen – Klinische Ethik-Komitees (PPT), Waldbreitbach, 2008.12.12

- Kompetenz und Geist – Führen und leiten in kirchlichen Einrichtungen – Menschen-Würde (PPT), Waldbreitbach, 2008.12.12

- Kompetenz und Geist – Führen und leiten in kirchlichen Einrichtungen – Mit Wörtern um Worte ringen Patientenverfügungen (PPT), Waldbreitbach, 2008.12.12

- Kompetenz und Geist – Führen und leiten in kirchlichen Einrichtungen – Weltethos eine Ethische Antwort auf die Herausforderungen unserer Zeit (PPT), Waldbreitbach, 2008.12.12

- Kompetenz und Geist – Führen und leiten in kirchlichen Einrichtungen – Werte Leben (PPT), Waldbreitbach, 2008.12.12

- Kompetenz und Geist – Führen und leiten in kirchlichen Einrichtungen – Zwischen Heilen und Lindern (PPT), Waldbreitbach, 2008.12.12

- Euthanasie in Luxemburg (PPT), Grosbus, 2008.12.04

- 9. Oktavpredigt - Zeugen der Liebe Gottes (Text), Echternach, 2008.11.16

- 7. Oktavpredigt - Aus dem Glauben leben lernen (Text), Echternach, 2008.11.13

- 8. Oktavpredigt - Das einfache Leben entspricht dem Glauben (Text), Echternach, 2008.11.13

- 5. Oktavpredigt - Die Globalisierung als neue Chance für das Christentum (Text), Echternach, 2008.11.12

- 6. Oktavpredigt - Klimawandel erforderlich (Text), Echternach, 2008.11.12

- 3. Oktavpredigt - Die Taufe deutet das Leben neu (Text), Echternach, 2008.11.11

- 4. Oktavpredigt - Auch die Ruinen halten Erinnerung wach (Text), Echternach, 2008.11.11

- 2. Oktavpredigt - Der Völkerapostel Paulus stellt die Weichen neu (Text), Echternach, 2008.11.10

- 1. Oktavpredigt - Bekehrung als Befreiung (Text), Echternach, 2008.11.06

- Deus Caritas est in action (PPT), executice committee of Caritas Internationalis, Rome, 2008.11.01

- Les défis d'une politique sociale au sein de l'Union Eruopéenne (PPT), Madrid, 2008.10.31

- Sozialpolitische Herausforderungen innerhalb der Europäischen Union (PPT), Wien, 2008.10.27

- 2eme journée de lutte contre la traite des êtres humains (Texte), Paris, 2008.10.16

- Weltethos – eine ethische Antwort auf die Herausforderungen unserer Zeit (PPT), Luxemburg, 2008.10.16

- Deus Caritas est – Caritas Polen Symposium (PPT), Warschau, 2008.10.04

- Deus Caritas est – Caritas Polen Symposium (Text), Warschau, 2008.10.04

- Caritas: Between professionalism, the formation of the heart and our faith (PPT), Budapest, 2008.09.10

- Und wenn sie nicht gestorben sind (Text), 2008.09.08

- Soirée d’information sur les soins palliatifs (PPT), Luxembourg, 2008.07.10

- Werte leben (PPT), Frankfurt, 2008.06.18

- Gaeste im Gespräch Thema Euthanasie, Bettembourg, 2008.06.14

- Grenzgänger Sozialarbeit zwischen Nächstenliebe und organisierter Solidarität (PPT), Bangkok, 2008.06.02

- Grenzgänger Sozialarbeit zwischen Nächstenliebe und organisierter Solidarität (Texte), Bangkok, 2008.06.02

- Gesprächsrunde CSJ zum Thema Euthanasie (PPT), Bascharage, 2008.05.30

- Conférence Régionale Caritas Europa, Changes Caritas Europa (PPT), Bled, 2008.05.21

- Conférence Régionale Caritas Europa, Changes Caritas Internationalis (PPT), Bled, 2008.05.21

- Streit um Euthanasie – zwei Gesetzesinitiativen in Luxemburg im Vergleich (PPT), Wien, 2008.05.16

- One crisis may hide another (PPT), Social Policy Forum Prague, Prague, 2008.04.27

- Unternehmerisches Handeln in der Caritas – Wo die Liebe drängt, setzt sie Wirtschaft und Politik in Bewegung (PPT), Köln, 2008.04.23

- Unternehmerisches Handeln in der Caritas – Wo die Liebe drängt, setzt sie Wirtschaft und Politik in Bewegung (Text), Köln, 2008.04.23

- Mit Wörtern um Worte ringen – Patientenverfüg-ungen – ein Zeichen und Ausdruck unserer Zeit (PPT), Schifflange, 2008.04.15

- Widerspruch Euthanasie. Zwei Gesetzesinitiativen im Vergleich, Luxemburger Wort, 2008.02.13

- Weil der Tod weder schön noch sanft ist!, Tageblatt, 2008.01.25

- Anwaltschaft schützt – letztlich auch die Einrichtung, Deutscher Cartitasverband e.V. (Hg): neue caritas 14-2008, Freiburg i.Br., 2008

- Les directives anticipées- comparaisons internationales des points de vue juridique et éthique. Vorwort und Einleitung, Bulletin de la Société des Sciences Médicales du Grand-Duché de Luxembourg, Numéro spéciale, 3/08, (Copyright by Société des Sciences Médicales du Grand-Duché de Luxembourg, Luxemburg, 2008

- Vorwort, Schronen, Danielle und Urbé, Robert (Hg): Sozialalmanach 2008. Schwerpunkt: Kinderarmut & Bildung. L’annuaire Caritas sur la situation sociale du Luxembourg, Luxemburg, 2008

- Zwischen den Gesetzen. Zur Euthanasie-Diskussion im Großherzogtum Luxemburg, zusammen mit Frank Jacob, Landesärztekammer K.d.ö.R. (Hg): Hessisches Ärzteblatt, Nr. 5, 69. Jahrgang, Mai 2008, Frankfurt/M, 2008

2007 - La responsabilité sociale des entreprises (PPT), Luxembourg, 2007.12.11

- Babylonische Sprachverwirrung. Über den Einfluss von Begriffen in der aktuellen Debatte um das Sterben, d’Land Forum, Nr. 4, Luxemburg, 2007.11.23

- Cohésion sociale et solidarités: changeons-nous de cap? (notes), Nantes, 2007.11.13

- Grenzgänger Sozialarbeit zwischen Nächstenliebe und organisierter Solidarität (PPT), Moulins-lès-Metz, 2007.11.09

- Im Herzen der Heilsgeschichte geschieht Liebe (Text), Moulins-lès-Metz, 2007.11.09

- Menschen (an)erkennen (Text), Deutschkreutz, 2007.11.03

- Kultur und Praxis von Führung und Partizipation in Organisationen der Caritas (PPT), München, 2007.10.26

- La Caritas: une intervention d'inspiration chrétienne pour un monde nouveau (Text), Moscou, 2007.10.19

- Quand le temps s'arrête (Text), Bruxelles, 2007.10.18

- Für welche Gerechtigkeit lohnt es sich zu kämpfen?, Vortrag im Rahmen der Europäischen Sozialkonferenz der Gewerkschaften (PPT), Remich, 2007.10.06

- Menschen (an)erkennen (Text), Trier, 2007.09.30

- Mit Wörtern um Worte ringen , Patientenverfügungen – ein Zeichen und Ausdruck unserer Zeit (Text), Vallendar, 2007.06.24

- Mit Wörtern um Worte ringen, Patientenverfügungen – ein Zeichen und Ausdruck unserer Zeit (PPT), Vallendar, 2007.06.24

- Séance Académique Caritas Luxembourg (Text), Luxembourg, 2007.06.15

- Vivre l'amour pour faire entrer la lumière de Dieu dans le monde, Assemblée Générale de Caritas Internationalis (Text), Rome, 2007.06.01

- Sozialwort der katholischen Kirche in Luxemburg - Pressekonferenz (PPT), 2007.05.11

- Vorstellung des Sozialwortes der katholischen Kirche Luxemburg - Tugenden bringen Licht in das Handeln des Menschen (PPT), Luxemburg, 2007.05.11

- En route vers la parole sociale - Journée de rencontre et d'échange (PPT), Luxembourg, 2007.03.17

- Menschenwürde - Eingang zur Menschwerdung (PPT), Freiburg, 2007.03.15

- Impulsreferat zum Sozialwort am Kader vum CSV-Nationalrod (PPT), Holzem, 2007.01.13

- Ausweg ins Leben, Theis, Prof. Dr. Joachim, Fleckenstein, Dr. Wolfgang, Maurer, Hans-Joachim;,Thomas, Dr. Michael und Wirtz, Dr. Hans-Gerd (Hg): Ich bin Christ – aus gutem Grund. Zur Anziehungskraft des Christseins heute; éditions trèves e.V., Trier, 2007

- Mit Wörtern um Worte ringen – Patientenverfügungen, Sonntagsmatineen 2007, Vallendarer Schriften zur Ethik, Heft 2, Dezember 2007, Vallendar, 2007

- om christlichen Engagement in der Gesellschaft, forum für Politik, Gesellschaft und Kultur 267/268, forum a.s.b.l. (Hg), Luxemburg, 2007

- Orientierungswissen für Führungskräfte – Ein Blick über die Grenzen, Consozial 2006. Mehrwert des Sozialen-Gewinn für die Gesellschaft. Allitera Verlag, München, 2007

- Sozialethik und Caritas bedingen sich gegenseitig, Deutscher Caritasverband e.V. (Hg): neue caritas 7-2007, Freiburg i.Br., 2007

- Vorwort, Schronen, Danielle und Urbé, Robert (Hg): Sozialalmanach 2007. Schwerpunkt: Soziale Gerechtigkeit. Das Caritas-Jahrbuch zur sozialen Lage in Luxemburg, Luxemburg, 2007

- Wie Ethik Moral voranbringt! Gedanken zur Notwendigkeit, Ethik zu studieren (Text), Eröffnung des Ethik-Instituts, Vorträge, Vallendarer Schriften zur Ethik, Heft 1, Koblenz, 2007

2006 - Neuanfang in Bam, revue, de Magazin fir Lëtzebuerg, nr. 51, Luxemburg, 2006.12.23

- La responsabilité sociale des entreprises - Rotary Club Luxembourg (PPT), Luxembourg, 2006.12.04

- Mehrwert des Sozialen - Gewinn für die Gesellschaft (PPT), Nürnberg, 2006.11.09

- Mehrwert des Sozialen - Gewinn für die Gesellschaft (Text), Nürnberg, 2006.11.09

- Wie Ethik Moral voranbringt! Gedanken zur Notwendigkeit, Ethik zu studieren (PPT), Vallendar, 2006.11.04

- Wie Ethik Moral voranbringt! Gedanken zur Notwendigkeit, Ethik zu studieren (Text), Vallendar, 2006.11.04

- Der diakonische Ansatz der Papstenzyklika „Deus Caritas est“ (PPT), Trier, 2006.10.28

- Wie treffen wir ethische Entscheidungen (PPT), Bad Kreuznach, 2006.05.31

- Keng Léift ouni Gerechtegkeet – keng Gerechtegkeet ouni Léift (PPT), Luxemburg, 2006.05.12

- Caritasverband Westeifel Bitburg (PPT), Bitburg, 2006.03.22

- La responsabilité sociale des entreprises - Economist Club Luxembourg (PPT), Luxembourg, 2006.03.09

- Wie Ethik Moral voranbringt! Beiträge zu Moral und Ethik in Medizin und Pflege, Lit-Verlag, Münster, 2006

2005 - Wider die gelernte Hilflosigkeit, Generalkapitel der Franziskanerinnen (PPT), 2005.10.13

- Fördern und fordern sogenannte ethische Gremien ethische Kompetenz?, Jahrestagung der Societas Ethica (PPT), Salzburg, 2005.08.24

- Ethische Betrachtungen zur Sterbebegleitung (PPT), Kassel, 2005.05.28

- Pflicht zu leben, Recht zu sterben? (Text), 2005.05.28

- L'information du patient en milieu clinique (PPT), Luxembourg, 2005.04.16

- Ethik als Entwicklung (PPT), Wien, 2005.03.08

- Klinische Ethik-Komitees (PPT), Wien, 2005.03.08

- Werte leben (PPT), St Wendel, 2005.01.20

- Fördern und fordern sogenannte 'ethische Gremien' ethische Kompetenz?, Europäische Forschungsgesellschaft für Ethik. (Hg). Societas Ethica. Jahresbericht 2005, ISSN: 1814-8204,, 2005

- Vom Rat zur Tat – Moralisch handeln und denken, Düwell, Marcus und Neumann, Josef N. (Hg): Wie viel Ethik verträgt die Medizin? mentis Verlag, Paderborn, 2005

2004 - L'option préférentielle pour la vie et le plus faible (PPT), Luxembourg, 2004.10.19

- Ethikberatung im Krankenhaus (PPT), Mühlheim/Ruhr, 2004.09.15

- Herausforderungen für "palliative care" (PPT), Luxemburg, 2004.06.01

- Menschenbild und Moral im Wandel der Zeit (PPT), Dudelange, 2004.03.15

- Zwischen Heilen und Lindern - Zur Entscheidungsfindung im Krankenhaus (PPT), Wien, 2004.03.08

- Hydratation in der Endphase – Für und wider (PPT), Ettelbrück, 2004.03.05

- Frag nur – ethische Reflexionen zu den Fragestellungen im Klinischen Ethik-Komitee, überarbeitete Fassung des Beitrags in der Broschüre Ethik-Komitee im Krankenhaus, Freiburg und Stuttgart 1999, Sass, Hans-Martin und May, Arnd T. (Hg): Behandlungsgebot oder Behandlungsverzicht. Klinisch-ethische Epikrisen zu ärztlichen Entscheidungskonflikten, Lit-Verlag, Münster, 2004

- Zur „Wieder-Holung“ der Moral, Gillen, Erny und Geißner, Ursula (Hg): Ethik und Autonomie. Wissenschaftliches Symposium an der Katholischen Fachhochschule Freiburg 2002, Lit-Verlag, Münster, 2004

2003 - Ethik,eine Übersetzungs- und Entscheidungshilfe im moralischen Engpass klinischer Alltagssituationen (PPT), Saarloius, 2003.12.11

- Vom Rat zur Tat - moralisch handeln und denken (PPT), Wittenberg, 2003.10.17

- Vom Rat zur Tat - moralisch handeln und denken (Text), Wittenberg, 2003.10.17

- Die Würde des Menschen, Eingang zur Menschwerdung (Text), Neunkirche, 2003.09.16

- Justicia et pax – The European convention (PPT), Luxembourg, 2003.03.02

- Älter werden in Würde - Perspektiven einer christlichen Ethik (PPT), Rastatt, 2003.02.11

- Die Würde des Menschen. Eingang zur Menschwerdung, Clemens-August-Stiftung (Hg): 50 Jahre Clemens-August-Stiftung, Dinklage, 2003

- Däi Wuert ass Liewen – Oktav-Priedegten 2003, Luxemburg, 2003

- Däi Wuert ass Liewen. Zur diesjährigen Muttergottesoktav, forum für Politik, Gesellschaft und Kultur, nr. 226, Mai 2003, Luxemburg, 2003

- Von unsichtbaren Frauen und Taliban. Ein Luxemburger in Afghanistan, Revue. De Magazin fir Lëtzebuerg, Nr.39, September 2003, Luxemburg, 2003

- Wenn die Vernunft praktisch wird. Sonderdruck, nos cahiers, Lëtzebuerger Zäitschrëft fir Kultur, 24. Joer, Luxemburg, 2003

2002 - Autonomie und Pflege (PPT), Esch-Alzette, 2002.12.04

- Autonomie und Pflege (Text), Esch-Alzette, 2002.12.04

- Ethik - eine Übersetzungs- und Entscheidungshilfe im moralischen Engpass klinischer Alltagssituationen (PPT), Trier, 2002.09.27

- Soins palliatifs - passiv Euthanasie - aktiv Euthanasie (PPT), Berbuerg, 2002.03.19

- Endstation Mensch – Organisationsformen für das Sterben der menschlichen Person (Text), 2002.02.01

- Ethik und Krankenhaus im Gespräch um das Wohl des Patienten (PPT), Bad Kreuznach, 2002.01.24

- Grenzen der Dialysebehandlung aus ethischer Sicht, Franz, H.E. (Hg): Dialyse 2001. Pabst Science Publishers, Lengerich, 2002

2001 - Über die Ohnmacht der Ethik, Die Autonomie der Person vollzieht sich in den Beziehungen zum anderen (Text), Freiburg, 2001.07.20

- Grenzen der Dialysebehandlung aus ethischer Sicht (PPT), Ulm, 2001.03.03

- Grenzen der Dialysebehandlung aus ethischer Sicht (Text), Ulm, 2001.03.03

- Und sie bewegt sich doch! Von der gestalterischen Kraft der Moral, Förderkreis der Freiburger Pflegestudiengänge e.V. (Hg): Kommunikation Kooperation Konflikt, Festschrift für Ursula Geißner, Freiburg i.Br., 2001

2000 - Gesundheit ist verhandelbar, Vortrag anlässlich des Theresientags (Text), Saarbrücken, 2000.10.01

- Leben - in Gottes und des Menschen Hand (Text), Luxembourg, 2000.04.04

- Autonome Moral im christlichen Kontext - eine bleibende Herausforderung an Vernunft und Glaube (Text), Luxemburg, 2000.03.07

- Endstation Mensch. Organisationsformen für das Sterben der menschlichen Person, Centre Jean XXIII (Hg), Apocalypse now? Zur religiösen Frage um die Jahrhundertwende, Luxemburg, 2000

- Sozialarbeit unter einem neuen Stern 1999. Überlegungen zum Wandel der Sozialarbeit, bulletin A.S., A.H.S., I.H.G. Association 2000/2, Luxemburg, 2000

- Subsidiaritéit, ECODEX nr 3, Mai, 2000

- Wie Christen ethisch handeln und denken. Aktueller Stand der Debatte um die Autonomie im Kontext katholischer Theologie, Centre Jean XXIII (Hg), Apocalypse now? Zur religiösen Frage um die Jahrhundertwende, Luxemburg, 2000

1999 - Frag nur – ethische Reflexionen zu den Fragestellungen im Klinischen Ethik-Komitee, Deutscher Evangelischer Krankenhausverband e.V. und Katholischer Krankenhausverband Deutschlands e.V. (Hg): Ethik-Komitee im Krankenhaus, Erfahrungsberichte zur Einrichtung von Klinischen Ethik-Komitees, Freiburg i.Br. und Stuttgart, 1999

- Leben – in Gottes und des Menschen Hand, Ostertag, Martin (Hg): Todeswunsch und Ungeduld am Lebensende. Hospizarbeit in der Bewährung, Reihe Loccumer Protokolle, Rehburg-Loccum, 1999

- Sozialarbeit unter einem neuen Stern 1999. Überlegungen zum Wandel der Sozialarbeit, Sonderdruck von Artikel im Luxemburger Wort, 1999

- Subsidiarität und Autonomie. Zu zwei Aufbauprinzipien unserer Gesellschaft., Sonderdruck zu Artikel im Luxemburger Wort vom 28.10., 3., 6. und 10.11.1999, Luxemburg, 1999

1998 - Ethik und Krankenhaus im Schatten der Ökonomie? (PPT), 1998.10.16

- Krankenhaus und Ethik im Schatten der Ökonomie? (Text), Würzburg, 1998.10.16

- Anspruch des Patienten auf « gleiche » Behandlung angesichts des medizinischen Fortschritts, überarbeitet nach einem Vortrag beim Symposium « Sinnvolle Rationierung medizinischer Leistungen » der Europäischen Akademie der Wissenschaften und Künste am 3. Mai 1997 in München, MMW Münchner Medizinische Wochenschrift, Sonderdruck, München, 1998

- Barmherzigkeit im pastoralen Handeln der Kirche, Deutscher Caritasverband (Hg): caritas, Zeitschrift für Caritasarbeit und Caritaswissenschaft, Heft 4, 99. Jahrgang, April 1998, Lambertus-Verlag, Freiburg i.Br., 1998

- Verzicht auf Diagnose und Therapie – Bestandteil einer guten und humanen Medizin. Ethische Herausforderungen an eine „neue Medizin“ – Wertentscheidungen, ECCLESIA Gruppe (Hg): Budgetierung, haftungsrechtlicher Sorgfaltsmaßstab des Gesetzes und Handlungsbedarf des Arztes am Bett des Patienten, Dokumentation des Symposiums der ECCLESIA Gruppe am 12./13.02.1998 in Düsseldorf, Detmold, 1998

1997 - Ethik im Haus für Kranke, Vortrag im Rahmen des 2. Katholischen Krankenhauskongresses (Text), Erfurt, 1997.10.09

- Ethik im Krankenhaus 2000 (PPT), Erfurt, 1997.10.09

- In der Tradition verwurzelte Zukunftsgestaltung, Aufgabe für eine ethische Entscheidungsfindung (Text), Köln und München, 1997.06.16

- Anspruch des Patienten auf "gleiche" Behandlung angesichts des medizinischen Fortschritts (Text), München, 1997.05.03

- Herausforderungen an klinische Ethik-Komitees, Vortrag anläßlich der 12. Malteser Krankenhaustagung zum Thema “System überwinden, Wandel gestalten, Zukunft gewinnen - unsere Qualität auf dem Prüfstand” (Text), Köln, 1997.03.15

- Anspruch des Patienten auf « gleiche » Behandlung angesichts des medizinischen Fortschritts, Vortrag im Rahmen der « academia scientiarum et artium europaea » Klasse II – Medizin « Medizin zwischen Machbarem und Verantwortbarem. Eine öffentliche und interdisziplinäre Veranstaltungsreihe » : 3. Symposium : « Sinnvolle Rationierung medizinischer Leistungen », gehalten am 3. Mai 1997 in München, Katholischer Krankenhausverband Deutschlands e.V. (Hg) : Krankendienst, Im Mittelpunkt der Mensch? Zwischenruf gegen den Trend, Lambertus-Verlag, München, 1997

- Ethik im Haus für Kranke, Katholischer Krankenhausverband Deutschlands e.V. (Hg) : Ein Haus für Kranke, der Patient ein Gast, Freiburg i.Br., 1997

- Sur les droits civiques et sociaux, forum fir kritesch Informatioun iwer Politik, Kultur a Relioun, nr. 175, Abrëll 1997, Luxemburg, 1997

1996 - Ethik und Ökonomie im christlichen Krankenhaus, Die Warte/ Perspectives, Luxemburger Wort, 1996.09.26

- Ethik und Ökonomie im christlichen Krankenhaus, Caritasverband für die Diözese Osnabrück (Hg): „Das katholische Krankenhaus – Neue Herausforderungen!“, 29. Norddeutscher Katholischer Krankenhaustag am 4./5. Juni 1996 in der Stadthalle Osnabrück, Oktober 1996, Osnabrück, 1996.06.04

- Ethik und Ökonomie im christlichen Krankenhaus, Vortrag anläßlich des 29. Norddeutschen Katholischen Krankenhaustags (Text), Osnabrück, 1996.06.04

- Ökonomie und Ethik (PPT), Osnabrück, 1996.06.04

- Unterwegs daheim – gestern und heute – bei den Franziskanerinnen von Waldbreitbach im Marienkrankenhaus in Trier-Ehrang, in Die Warte/Perspectives, Luxemburger Wort, 1996.01.04

- Bedingungen für eine gerechte Sozialarbeit aus europäischer Perspektive,, Caritas-Verband der Erzdiözese München und Freising (Hg): Markt und Ethik. Management sozialwirtschaftlicher Organisationen, München, 1996

- Ethik und Ökonomie im christlichen Krankenhaus, Katholischer Krankenhausverband Deutschlands e.V. (Hg) : Krankendienst, Ethik und Ökonomie im christlichen Krankenhaus, Freiburg i.Br., 1996

- Ethik und Ökonomie im christlichen Krankenhaus, Sonderdruck, 1996

- Ethische Komitees im kirchlichen Krankenhaus, Katholischer Krankenhausverband Deutschlands e.V. (Hg) : Krankendienst, Ethik-Komitee im Krankenhaus, Freiburg i.Br., 1996

1995 - Bedingungen für eine gerechte Sozialarbeit. Sozialethische Thesen zum Verständnis der Sozialarbeit zwischen Staat und privaten Trägern, d’wissbei. zäitschrëft fir chrëschtlech Gemeinschaft, Nr. 42/43, Luxemburg, 1995.12.15

- Bedingungen für eine gerechte Sozialarbeit aus europäischer Perspektive,, Sonderdruck: Bedingungen für eine gerechte Sozialarbeit aus europäischer Perspektive, Thesen zur Diskussion, Impulsreferat von Prof. Dr. Erny Gillen, Luxemburg, im Rahmen des 2. Caritas Forum München Markt und Ethik, Kloster Seeon/Oberbayern,, 1995.12.01

- Unterwegs daheim im christlichen Krankenhaus (Text), Trier, 1995.09.16

- Unterwegs daheim im Kloster (Text), Trier, 1995.09.16

- Unterwegs daheim – gestern und heute – bei den Franziskanerinnen von Waldbreitbach im Marienkrankenhaus in Trier-Ehrang, Festvortrag, Sonderdruck, 1995.09.16

- Bio-Ethische Komitees im Gebrauch der Gesundheitsorganisatoren (PPT), Luxemburg, 1995.06.01

- Bioethische Kommitees (PPT), Köln, 1995.06.01

- Bioethische Kommitees (Text), Köln, 1995.06.01

- Bedingungen für eine gerechte Sozialarbeit. Sozialethische Thesen zum Verständnis der Sozialarbeit zwischen Staat und privaten Trägern, d’Wissbei, Zäitschrëft fir chrëschtlech Gemeinschaft, Nr 42/43, Dezember 1995, Luxemburg, 1995

- Erlösung als Versöhnungsdienst, aspekte. theologische und pastorale blätter für die diözese luxemburg, Nr. 48, Dezember 1995, Luxemburg, 1995

- Und wenn sie nicht gestorben sind, …, zusammen mit Frank Jacob, Katholischer Krankenhausverband Deutschlands e.V. (Hg) : Krankendienst, Und wenn sie nicht gestorben sind. Ein Beitrag zur neuen Hirntod-Diskussion, Mai 1995, Freiburg i.Br., 1995

- Zur Einführung von Ethischen Komitees, Sonderdruck, 1995

1994 - Ethik und Medizin im Gespräch um den kranken Menschen (Texte), Berlin, 1994.03.16

- Caritas-Leitbilder in Europa (plus Kommentar: Caritasverbände in Europa. Annäherungsversuche), Deutscher Caritasverband (Hg): Caritas, Zeitschrift für Caritasarbeit und Caritaswissenschaft: Zeit für ein Leitbild, Lambertus-Verlag, Freiburg i.Br., 1994

- Darf der Mensch sich sein Leben nehmen? Ethische Anmerkungen aus christlich-theologischer Sicht, D’Wissbei, Zäitschrëft fir chrëschtlech Gemeinschaft, Nr. 31/32, März 1994, Luxemburg, 1994

- Freiheit in der Wahrheit, nos cahiers, lëtzebuerger zäitschrëft fir kultur, nr 3, 1994, Luxemburg, 1994

- Introduction, Fédération Caritas (Hg): Kanner-Aarmut och zu Lëtzebuer, Luxemburg, 1994

- Verzicht auf Therapie als integraler Bestandteil guter und humaner Medizin – nach der Lehre der Kirche, forum fir kritesch Informatioun iwer Politik, Kultur a Relioun, nr 152, Juni 1994, Luxemburg, 1994

1993 - Im Namen der Ethik, ein Stachel gegen die Selbstgenügsamkeit (Text), Freiburg im Breisgau, 1993.10.13

- An wessen Hand ... Das Leiden des Menschen in Gottes Hand (Text), Freiburg, 1993.05.22

- An wessen Hand…, Sonderdruck zum Vortrag im Rahmen des 10. Bundeskongresses des Caritas-Gemeinschaft für Pflege- und Sozialberufe e.V. vom 20.-24. Mai 1993, Freiburg i.Br., 1993.05.20

- AIDS: eine ethische Herausforderung auch für die Sozialarbeit der Caritas. Einige Thesen zur Diskussionsanregung, AIDS. Eine ethische Herausforderung, Krankendienst, Zeitschrift für Kath. Krankenhäuser, Sozialstationen und Pflegeberuf, 66. Jahrgang, März 1993, Lambertus-Verlag, Freiburg i.Br., 1993

- An wessen Hand…, Katholischer Krankenhausverband Deutschlands e.V. (Hg) : Krankendienst, An wessen Hand…Reflexionen zu Grundfragen der Pflege, Lambertus-Verlag, Freiburg i.Br., 1993

- An wessen Hand…, Sonderdruck, 1993

- An wessen Hand…, Caritas-Gemeinschaft für Pflege- und Sozialberufe e.V. (Hg): Pflege das Leben, wo du es antriffst. Förderung-Forderung-Herausforderung, Sonderdruck, Freiburg i.Br., 1993

- Caritas-Leitbilder in Europa (plus Kommentar: Caritasverbände in Europa. Annäherungsversuche), Deutscher Caritasverband (Hg): Caritas, Zeitschrift für Caritasarbeit und Caritaswissenschaft, Heft 7: Soziale Arbeit ohne Grenzen. Caritas-Leitbilder in Europa, Lambertus-Verlag, Freiburg i.Br., 1993

- „Time-out“ für die Caritas, Fédération Caritas asbl (Hg): 60 joer caritas. Jahresbericht 1992, Luxemburg, 1993

- « Im Namen der Ethik …- Ein Stachel gegen die Selbstgenügsamkeit », Festvortrag zur Feierlichen Eröffnung des Fachbereichs Pflege und Verabschiedung des scheidenden Verwaltungsratsvorsitzenden der KFH Dr. Kurt Nachbauer, KFH Focus, Sonderheft 5 Pflegestudiengänge, Freiburg i.Br., 1993

- « Im Namen der Ethik …- Ein Stachel gegen die Selbstgenügsamkeit », Festvortrag zur Feierlichen Eröffnung des Fachbereichs Pflege und Verabschiedung des scheidenden Verwaltungsratsvorsitzenden der KFH Dr. Kurt Nachbauer, Sonderdruck, 1993

1992 - Der Verzicht auf Diagnose und Therapie: Bestandteil einer guten und humanen Medizin? (Text), Hannover, 1992.06.02

- Gedanken zur Autonomie der Sozialarbeit im Umfeld von Gesellschaft, Staat und Politik (Text), 1992.05.17

- Palliative Therapie und Heilen – ein Gegensatz?, Die Warte/Perspectives, Luxemburger Wort vom 6. Februar 1992, Luxemburg, 1992.02.06

- A.I.D.S. – eine ethische Herausforderung auch für die Sozialarbeit der Caritas. Einige Thesen zur Diskussionsanregung,, Sonderdruck, 1992

- Der Verzicht auf Diagnose und Therapie : Bestandteil einer guten und humanen Medizin?, Katholischer Krankenhausverband Deutschlands e.V. (Hg) : Der Verzicht auf Diagnose und Therapie : Bestandteil einer guten und humanen Medizin ?, Freiburg i.Br., 1992

- Etwas ausführlicher, Gedanken zur Autonomie der Sozialarbeit im Umfeld von Gesellschaft, Staat und Politik, Sonderdruck, Luxemburg, 1992

- Handwerkszeug Philosophie. Eine Glosse von Erny Gillen über das Regelwerk „Sprache“ am Beispiel „Euthanasie“, Sonderdruck aus nos cahiers, lëtzebuerger zäitschrëft fir kultur, 4/1992, Luxemburg, 1992

- Palliative Therapie und Heilen- ein Gegensatz?, Katholischer Krankenhausverband Deutschlands e.V. (Hg) : Krankendienst, Pflege wohin? Von der Betroffenheit zur Argumentation, Freiburg i.Br., 1992

- Zur Autonomie der Sozialarbeit im Umfeld von Gesellschaft, Staat und Politik, forum fir kritesch Informatioun iwer Politik, Kultur a Relioun, nr. 136, Luxemburg, 1992

1991 - (zum Thema 100 Jahre Rerum Novarum, sozialforum 1991) ohne Titel, Sonderdruck, nos cahiers, lëtzebuerger zäitschrëft fir kultur, 12.joer 1991, Luxemburg, 1991

- Der Verzicht auf Therapie. Bestandteil einer guten und humanen Medizin nach der Lehre der Kirche, Krankendienst. Zeitschrift für Kath. Krankenhäuser, Sozialstationen und Pflegeberufe, 64. Jahrgang, Juni 1991, Lambertus-Verlag, Freiburg i.Br., 1991

- Laßt die Kinder kommen…Plädoyer für die Kinderrechte, Luxemburger Marienkalender 1992, Luxemburg, 1991

- Palliative Therapie und Heilen – Ein Gegensatz?, Sonderdruck, Luxemburg, 1991

- Stellungnahme von acht christlich engagierten Arbeitsgruppen zu einigen sozialethischen Brennpunkten, Sonderdruck zum sozialforum ’91, nos cahiers, lëtzebuerger zäitschrëft fir kultur, 12.joer, 1991, Luxemburg, 1991

- Von der Gnosis zum Prinzip Verantwortung. Ein Gespräch mit Hans Jonas, zusammen mit Jean Greisch, nos cahiers, lëtzebuerger zäitschrëft fir kultur, 12. Joër, 1991, Luxemburg, 1991

- Wenn das Leben des Menschen zur Debatte steht, Deutscher Caritasvrband (Hg): caritas, Zeitschrift für Caritasarbeit und Caritaswissenschaft, Heft 8, 92. Jahrgang, August 1991, Lambertus-Verlag, Freiburg i.Br., 1991

- Wenn das Leben des Menschen zur Debatte steht. Theologisch-ethische Überlegungen zu Beginn und Ende menschlichen Lebens, Druckvorlage „caritas“, 1991

1990 - Caritas-Vorstellungen, Fédération Caritas asbl (Hg): caritas ’90 Jahresbericht, Luxembourg, 1990

- Commission sociale, Fédération Caritas asbl (Hg): caritas ’90 Jahresbericht, Luxembourg, 1990

- Der Kampf ums Leben auch im Sterben! Zum gesellschaftlichen Konflikt um die Würde des sterbenden Menschen, zusammen mit Elisabeth Osborne-Werner, d’Wissbei Zäitschrëft fir chrëschtlech Gemeinschaft nr 12/13, Luxembourg, 1990

- Plädoyer für eine therapeutische Diakonie. Zur Ethik des gesellschaftlichen und kirchlichen Umgangs mit der Krankheit AIDS, Krankendienst 8/9, Zeitschrift für Katholische Krankenhäuser, Sozialstationen und Pflegeberufe, Lambertus-Verlag Freiburg i.Br., 1990

- Von der Gnosis zum Prinzip Verantwortung. Ein Gespräch mit Hans Jonas, Sonderdruck, 1990

1989 - Wenn Gott in die Geschichte der Menschen eintritt, Luxemburger Wort vom 18.12.1989, Luxembourg, 1989.12.18

- Wie Christen ethisch handeln und denken. Zur Debatte um die Autonomie der Sittlichkeit im Kontext katholischer Theologie, Echter Verlag Würzburg 1989; ISBN 3-429-01216-3, 1. und 2. Auflage, Würzburg, 1989

1987 - Aspects éthiques, Ministère de la Famille, du Logement social et de la Solidarité sociale, Ministère de la Justice, Ministère de la Santé (Hg) : Nouvelles méthodes de procréation médicalement assistée, Luxembourg, 1987

1982 - Unterwegs Daheim. Auseinandersetzung mit den Anforderungen eines heutigen Ferienlagers, cinquantenaire de la caritas luxembourgeoise 1932-1982, Imprimerie Saint-Paul S.A., Luxembourg, 1982

|